7月18日13:30-16:30,YAGO知识库创始人、法国巴黎电信大学法比安·苏卡内克(Fabian M. Suchanek)教授以远程接入的方式,继续为本次暑期学校带来知识库相关的第二场报告,主题为深度自然语言处理。报告详细介绍了深度学习在自然语言处理上的应用。整个报告分为三大部分:感知机、词向量化(Word2Vec)和知识库表征。

首先是关于感知机。其本质是为了模仿人体大脑神经元处理信息的过程而诞生的计算结构。这种线性计算加激活函数的简单计算单元具有非常强大的能量,将感知机进行简单的堆叠组合理论上就可以拟合任何复杂的函数,是一种通用逼近器。

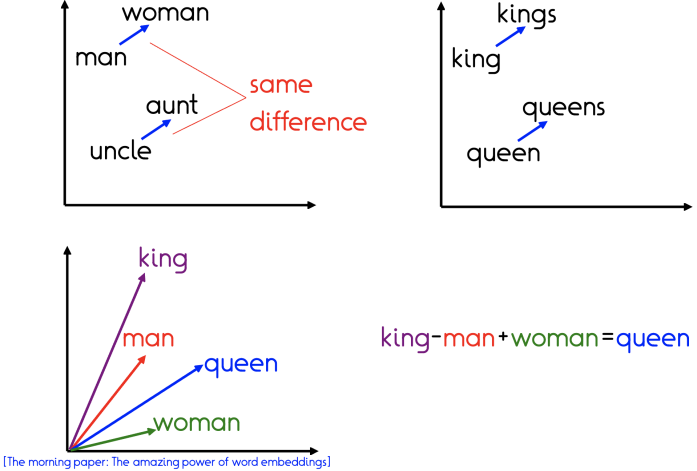

随后,法比安教授讲述了词向量化(Word2Vec)。这是生成词向量的方式之一,实现将词表示成“可计算”和“结构化”的向量。简单地说,Word2Vec是用一层神经网络把独热编码形式的稀疏词向量映射成为一个多维(维度一般为几百)的稠密向量的过程。Word2Vec有两个重要的模型:CBOW模型与Skip-gram模型。CBOW的输入是上下文,输出是中间词,即通过上下文内容来预测中间词。Skip-Gram与CBOW的输入输出正好相反,Skip-gram是以中心词作为输入,上下文作为输出。Word2Vec考虑上下文环境,效果更好,并且维度更少,所以速度更快、通用性很强,广泛地用在各种自然语言处理任务中;缺点在于由于词和向量是一对一的关系,所以多义词的问题无法解决。Word2Vec 是一种静态的表示方式,虽然通用性强,但是无法针对特定任务做动态优化。此外,通过词到向量的转化,Word2Vec可以支持基于向量进行各种运算。图1所示,单词king经常和queen出现在一起,而man经常和woman出现在一起,通过Word2Vec分析可以发现代表king的矢量可以跟代表queen、man和woman的矢量有如下简单的关系:king=queen-woman+man。

图1 Word2Vec的应用

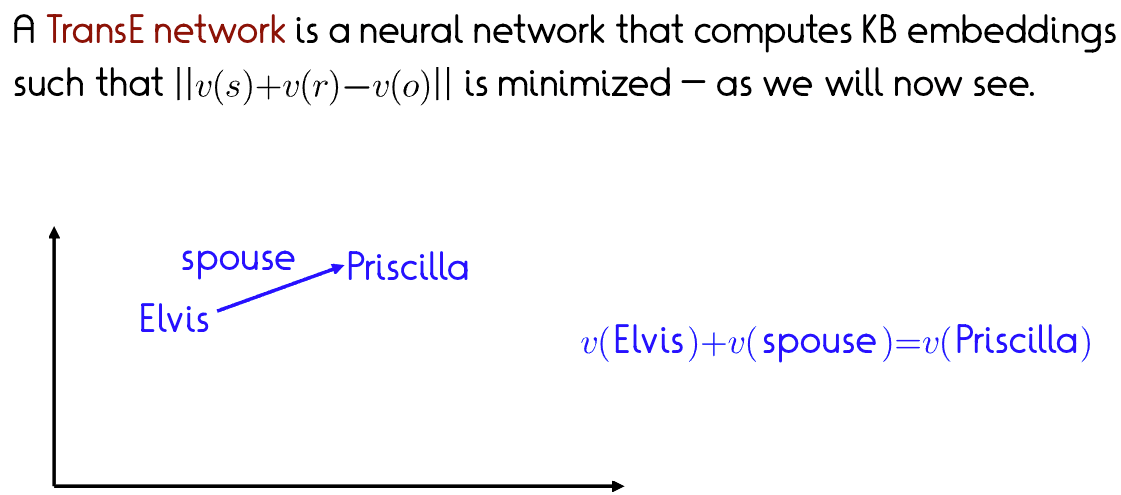

接下来,法比安教授讲述了知识库表征。他重点介绍了TransE模型。表示学习起源于Mikolov等人于2013年提出的Word2vec词表示学习模型和工具包,在自然语言处理领域受到广泛关注。利用该模型,Mikolov等人发现词向量空间存在平移不变现象(图2)。受到该平移不变现象的启发,Border等人提出了TransE模型,将知识库中的关系看作实体间的某种平移向量。对于每个事实三元组(头实体,关系,尾实体),TransE模型将实体和关系表示在同一空间中,其中关系向量可以看作为头实体向量和尾实体向量之间的平移,即头实体向量 + 关系向量 ≈ 尾实体向量。比如:对于给定的两个事实(姜文,妻子,周韵)和(冯小刚,妻子,徐帆) ,除了可以得到:姜文+妻子≈周韵和冯小刚+妻子≈徐帆,还可以通过平移不变性得到:周韵–姜文≈徐帆–冯小刚,即得到两个事实相同的关系的向量表示。

图2 TransE中向量平移关系:头实体向量 + 关系向量 ≈ 尾实体向量

报告期间,老师和同学们与法比安教授进行了多次互动。陆雪松老师问了关于感知机的问题,比如对感知机进行优化时,不清楚训练数据和输入的区别。在涉及到支持向量机和核函数时,法比安教授和同学之间的热情互动让同学们理解得更加透彻。同时,同学们对教育领域中的自然语言处理与深度学习的结合特别感兴趣,就“利用深度学习从自然语言中挖掘数理逻辑是否可行”展开了讨论。法比安教授在授课结束后还耐心地回答了同学们的许多问题。

报告人简介:

法比安·苏卡内克(Fabian M. Suchanek)是法国巴黎电信大学的正式教授。他开发了YAGO知识库,这是最大的公共通用知识库之一。为此,他获得了SIGMOD学位论文奖和WWW会议(WWW 2018)的十年时间测试奖。法比安教授的研究兴趣包括信息提取、自动推理和知识库。法比安教授在ISWC,VLDB,SIGMOD,WWW,CIKM,ICDE和SIGIR等领域发表了约90篇学术论文,其著作被引用了10000多次。

撰稿 | 朱鹏

排版 | 孙家博